EY oznacza globalną organizację i może odnosić się do jednej lub więcej firm członkowskich Ernst & Young Global Limited, z których każda stanowi odrębny podmiot prawny. Ernst & Young Global Limited, brytyjska spółka z ograniczoną odpowiedzialnością, nie świadczy usług na rzecz klientów.

Wdrożenie AI bez odpowiednich ram zarządzania może prowadzić do nieprzewidzianych ryzyk i komplikacji. Wczesne ustanowienie odpowiedniego modelu AI Governance pozwala organizacjom na zrozumienie, identyfikację oraz ograniczenie potencjalnych zagrożeń związanych z AI, zanim te staną się problemem.

W skrócie:

- Jakie wyzwania stoją przed organizacjami przy wdrażaniu strategicznych ram AI, szczególnie w kontekście zmieniającego się środowiska regulacyjnego?

- Dlaczego ustanowienie ram zarządzania AI jest kluczowe dla organizacji?

- Jak sektor ubezpieczeniowy wykorzystuje sztuczną inteligencję do poprawy swoich operacji i które konkretne obszary odnoszą największe korzyści?

1. Jaki wpływ sztuczna inteligencja ma obecnie na sektor ubezpieczeniowy?

W ostatnich miesiącach w branży ubezpieczeniowej obserwuje się wzrost oczekiwań stawianych sztucznej inteligencji. Nowa technologia oferuje wachlarz możliwości, które usprawnią wiele obszarów działalności w sektorze. Do potencjalnych korzyści zalicza się nie tylko redukcję kosztów operacyjnych, ale również efektywniejsze wykorzystanie informacji w kluczowych etapach łańcucha wartości. W szczególności sztuczna inteligencja może poprawić precyzję oceny ryzyka, co umożliwi jego dokładniejszą wycenę.

Wydaje się jednak, że największe zmiany w zakresie wykorzystania AI, wciąż są przed nami – zarówno jeśli chodzi o nowe produkty, lepiej dostosowane do indywidualnych potrzeb odbiorców, jak i pozyskiwanie klientów, usprawnione hiper-personalizacją ofert na niespotykaną dotąd skalę. Należy się spodziewać, że zwiększona różnorodność opcji produktowych doprowadzi do powstania nowych wyzwań operacyjnych, co z kolei przełoży się na dalsze zapotrzebowanie na wykorzystanie sztucznej inteligencji. Firmy, które jako pierwsze podążą tą ścieżką, wytyczą kierunki rozwoju całej branży.

Bezpośrednio na maila

Bądź na bieżąco i subskrybuj newsletter EY

2. W jaki sposób organizacje wdrażają możliwości sztucznej inteligencji?

Dynamiczny rozwój generatywnej sztucznej inteligencji (GenAI), który obserwowany jest zwłaszcza w ostatnich miesiącach, znacząco przyspieszył działania przedsiębiorstw w kierunku wdrażania AI. Obecnie, kluczowym wyzwaniem dla podmiotów ubezpieczeniowych jest stworzenie strategii sztucznej inteligencji. Dla wielu będzie to debiut w planowaniu strategicznym w tej sferze. Kompleksowość zadania wynika z faktu, że systemy AI są tworzone na przecięciu technologii, danych, algorytmów i biznesu, co wymaga wszechstronnego podejścia do organizacji i jej działalności.

Choć pierwsze, pojedyncze implementacje sztucznej inteligencji w sektorze mamy już za sobą, do szerokiego wykorzystania AI w procesie transformacji jeszcze daleka droga. Większość podmiotów na rynku zdaje sobie sprawę, że wdrożenie nowych rozwiązań wymaga modyfikacji modelu operacyjnego. Pojawiają się także specjalne zespoły mające na celu przyspieszenie tego procesu i odpowiednie zarządzanie nowymi projektami. Warto dodać, że odbywa się to w kontekście ewoluującego środowiska regulacyjnego.

Nadchodzące unijne rozporządzenie dotyczące sztucznej inteligencji (AI Act) ma zapewnić branży jasne wytyczne w zakresie zgodności nowych systemów z prawem. Co interesujące, zawarta tam szeroka definicja systemów AI obejmie swym zakresem wiele rozwiązań już funkcjonujących w sektorze. Ponadto, w odróżnieniu od dotychczasowych regulacji, obejmujących wykorzystywane modele ubezpieczeniowe, gdzie ryzyko modelowe mierzone jest m.in wielkością wpływu na wskaźniki finansowe, AI Act wprowadza klasyfikację ryzyka podyktowaną wpływem społecznym i implikacjami etycznymi. Wymaga to od organizacji wdrażających sztuczną inteligencję poszerzenia kompetencji w zakresie testowania, ewaluacji oraz walidacji rozwiązań AI.

3. Wyzwania związane z nadzorem rozwiązań sztucznej inteligencji

W dobie rosnącej obecności sztucznej inteligencji w różnych sektorach gospodarki, zarówno twórcy, jak i użytkownicy systemów stają przed szeregiem wyzwań.

Wyzwania Regulacyjne

Regulacje prawne dotyczące AI zaczynają obejmować cały cykl życia tych systemów, od ich tworzenia po wdrożenie i eksploatację. Rosnąca złożoność regulacji wymaga od organizacji dodatkowych działań, aby zapewnić zgodność z prawem. Wyzwania regulacyjne pojawiają się również na tle stosowania już istniejących przepisów. Wynika to przede wszystkim z faktu, że tradycyjne systemy prawa często nie uwzględniają unikalnych cech AI, takich jak ciągłe uczenie się i autonomia.

Efektywność Procesu i Zwinność

Manualne przeglądy oraz walidacje systemów AI są czasochłonne i mogą być przeprowadzane w sposób niestandardowy w ramach organizacji, co utrudnia zrozumienie podjętych decyzji. Opóźnienia w przeglądach mogą hamować wdrożenie AI, a w dłuższej perspektywie obniżać efektywność i przydatność modeli.

Koszty Zgodności i Kary

Zarządzanie ryzykiem związanym z AI jest kosztowne, gdyż ewentualny brak zgodności z nadchodzącymi regulacjami prowadzić będzie do obciążenia podmiotu wysokimie karami administracyjnymi. Tymczasem, niewystarczający monitoring i kontrola mogą osłabiać działania naprawcze i prewencyjne, co zwiększa ryzyko wystąpienia problemów z zarządzaniem.

Złożoność Modelu i Dryf Danych

Wzrost złożoności modeli AI utrudnia identyfikację ryzyka. Ponadto, regulacje często zakładają stabilność danych, podczas gdy ich rzeczywistości zmienność może znacząco wpływać na działanie systemów.

Monitorowanie, Raportowanie i Testowanie

Stopień skomplikowania nowej technologii rośnie w szybkim tempie, co utrudnia dokładny nadzór i wypełnianie obowiązków regulacyjnych. Brak jednoznacznych metod testowania modeli AI utrudnia zapewnienie ich zgodności z przepisami.

Adaptacja Regulacyjna i Wydajność

Kluczowe jest stworzenie skutecznego mechanizmu monitorowania działania systemów AI przez osoby z odpowiednimi kompetencjami. Ponadto, ewentualne aktualizacje regulacji mogą sprawić, że modele funkcjonujące w organizacji staną się niezgodne z obowiązującymi wymaganiami.

4. Dlaczego wdrożenie GenAI powinno rozpocząć się od ram zarządzania AI?

Jak wskazano powyżej, w dobie cyfrowej transformacji, sztuczna inteligencja staje się coraz bardziej wszechobecna, a jej generatywne odmiany, przynoszą nowe możliwości rozwoju i wdrażania innowacji dla ubezpieczycieli. Jednakże, aby w pełni wykorzystać potencjał tej technologii, niezbędne jest ustanowienie solidnych ram zarządzania.

Wdrożenie AI bez odpowiednich ram zarządzania może prowadzić do nieprzewidzianych ryzyk i komplikacji. Wczesne ustanowienie odpowiedniego modelu AI Governance pozwala organizacjom na zrozumienie, identyfikację oraz ograniczenie potencjalnych zagrożeń związanych z AI, zanim te staną się problemem. Warto pamiętać, że dobrze skonstruowane ramy zarządzania sztuczną inteligencją nie narzucają konkretnego balansu pomiędzy ryzykiem, a korzyściami, tym samym ograniczając potencjał AI, a raczej pozwalają w usystematyzowany sposób zarządzić nowymi rozwiązaniami w kontekście danej organizacji. Wymagają tym samym mądrego wdrożenia oraz otwartości na zmiany na różnych szczeblach przedsiębiorstwa.

Organizacje, które efektywnie wdrażają zarządzanie systemami AI, charakteryzują się kilkoma kluczowymi strategiami:

a. Zarządzanie ryzykiem: Liderzy w dziedzinie AI Governance rozumieją potencjalne ryzyka związane z AI i podejmują działania, aby je ograniczyć. Dzięki temu mogą zapobiegać problemom, zanim te wpłyną na działalność firmy.

b. Identyfikacja obszarów o wysokiej wartości: Organizacje proaktywnie szukają obszarów, w których wdrożenie AI przyniesie największe korzyści. Pozwala to na skupienie zasobów i wysiłków tam, gdzie zaowocują największym zwrotem z inwestycji.

c. Skalowanie najlepszych praktyk: Wnioski z wczesnych projektów pilotażowych są szeroko wykorzystywane, aby zapewnić spójność i efektywność w całej organizacji. Liderzy w AI Governance wykorzystują te doświadczenia do tworzenia standardów i procedur, które mogą być stosowane w różnych projektach.

d. Ochrona przychodów: Organizacje nie tylko generują przychody dzięki AI, ale także chronią je poprzez zarządzanie ryzykiem i zapewnienie zgodności. To podejście przyspiesza zwrot z inwestycji i buduje trwałą wartość.

e. Wdrażanie na dużą skalę: Liderzy w dziedzinie AI Governance nie ograniczają się do małych eksperymentów. Zamiast tego, wdrażają AI na szeroką skalę, maksymalizując jej wpływ na różne funkcje i jednostki organizacyjne, co przekłada się na znaczące korzyści dla całej firmy.

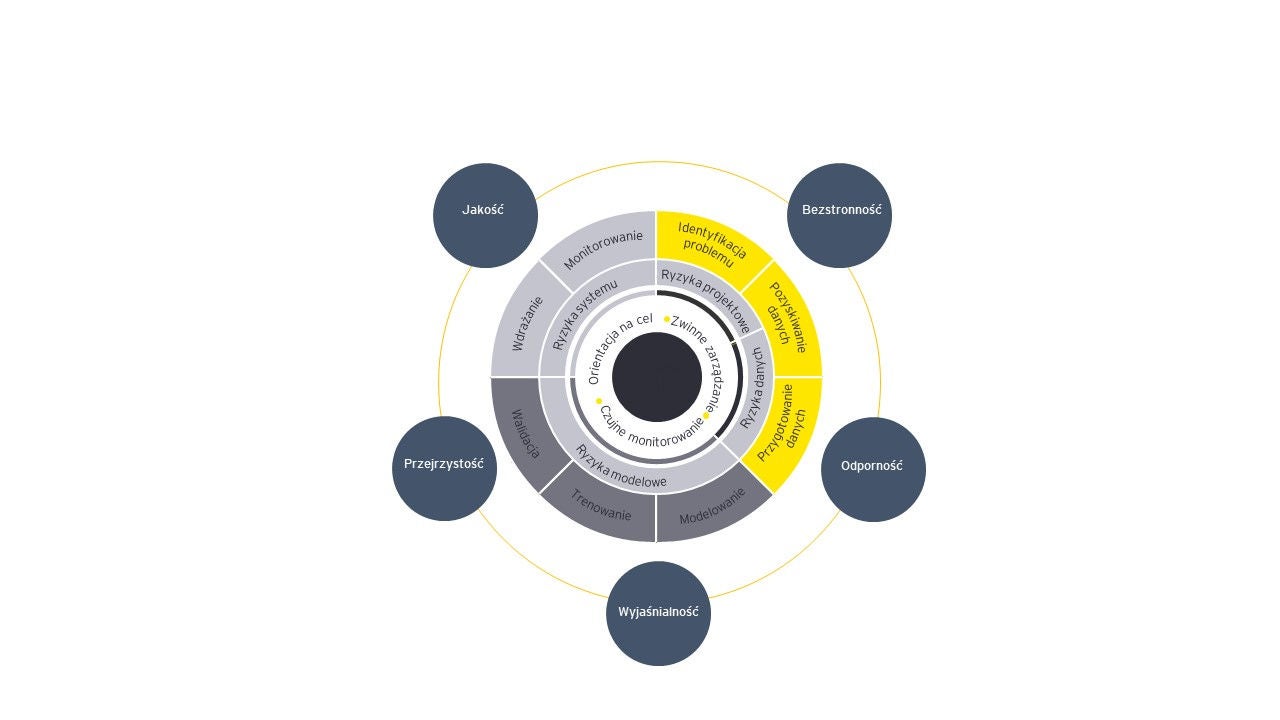

Budowanie zaufania do rozwiązań sztucznej inteligencji

W wielu branżach, w których sztuczna inteligencja staje się kluczowym narzędziem, niezwykle ważne jest, aby wdrożenie nowej technologii było przeprowadzone w sposób odpowiedzialny i zgodny z wartościami organizacji. Niezależnie od wybranego podejścia implementacja rozwiązań AI powinna odbywać się ze szczególnym naciskiem na jakość, bezstronność, odporność, wyjaśnialność oraz przejrzystość w działaniu.

Jakość w kontekście AI oznacza, że rezultaty generowane przez systemy sztucznej inteligencji spełniają oczekiwania interesariuszy i charakteryzują się wysokim poziomem precyzji oraz spójności. Jest to fundament, na którym buduje się zaufanie do wyników zwracanych przez systemy AI.

Bezstronność jest kluczowa, aby zapewnić, że systemy AI są wolne od niezamierzonych uprzedzeń, które mogą wynikać z różnorodnych czynników, takich jak skład zespołu programistów, wykorzystywane dane czy metody treningowe. Dzięki identyfikacji i eliminacji tych obciążeń na etapie projektowania, systemy AI mogą lepiej służyć wszystkim użytkownikom i przyczyniać się do pozytywnego wpływu społecznego.

Odporność systemów AI odnosi się do ich zdolności do ochrony danych przed nieautoryzowanym dostępem, uszkodzeniem czy wyciekiem. Jest to aspekt szczególnie istotny w kontekście rosnących zagrożeń związanych z cyberbezpieczeństwem i wymaga stałej uwagi w procesie zarządzania systemami AI.

Wyjaśnialność wymaga by metody treningowe i procesy decyzyjne stosowane przez AI były transparentne, udokumentowane i dostępne do weryfikacji. Umożliwia to użytkownikom zrozumienie, jak systemy AI formułują konkretne wnioski, co jest niezbędne dla budowania zaufania i akceptacji rozwiązań.

Przejrzystość w interakcji z AI zapewnia użytkownikom odpowiednie informacje i kontrolę nad tym, jak i kiedy ich dane są wykorzystywane. Wymaga to jasnych zasad dotyczących gromadzenia i wykorzystywania danych, a także uzyskania zgody użytkownika na te działania.

5. Wdrażanie AI Governance w organizacji – Przewodnik Krok po Kroku

W dobie dynamicznego rozwoju technologii, sztuczna inteligencja staje się kluczowym elementem strategii wielu firm. Jednak z jej wdrożeniem wiążą się liczne wyzwania związane z zarządzaniem i ryzykiem. Dlatego tak ważne jest, aby organizacje przyjęły skuteczne ramy zarządzania AI, czyli tzw. AI Governance. Ale jak to zrobić?

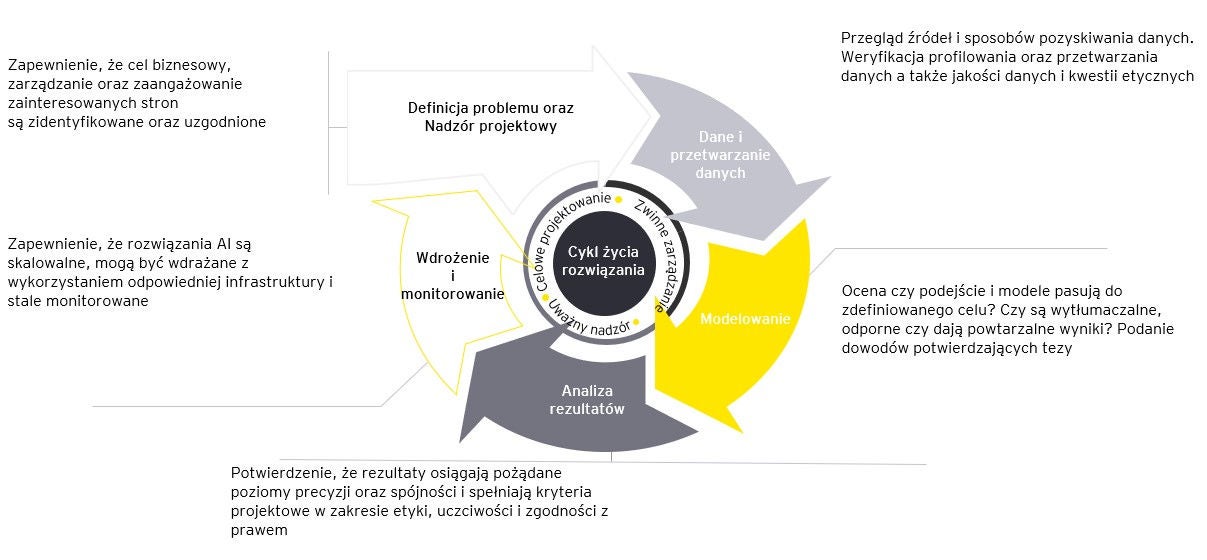

Pierwszym krokiem jest analiza gotowości organizacji do wdrożenia AI. Proces ten rozpoczyna się od szczegółowej analizy stanu faktycznego, w tym opracowania definicji systemu AI, stworzenia rejestru rozwiązań wykorzystujących AI oraz zebrania istotnych informacji i dokumentów. Należy tu uwzględnić aspekty takie jak cykl życia rozwiązań IT, zarządzanie ryzykiem modeli, praktyki utrzymania jakości i prywatności danych, bezpieczeństwo informatyczne oraz polityki prowadzenia działalności. Następnie dokonuje się ogólnej oceny dojrzałości organizacji pod kątem wdrażania AI.

Kolejnym etapem jest analiza luki regulacyjnej, która polega na zmapowaniu regulacji istotnych dla działań w obszarze AI, prowadzonych przez dane przedsiębiorstwo. Szczególną uwagę należy zwrócić na ocenę zgodności z przepisami AI Act oraz innych regulacji właściwych dla sektora ubezpieczeniowego. W tym celu analizuje się istniejące praktyki zarządzania ryzykiem rozwiązań technologicznych ze szczególnym naciskiem na nadzór nad jakością danych, standardy dokumentacji technicznej, rejestrowanie działania systemów AI, przejrzystość stosowania AI, ciągły nadzór i monitorowanie oraz odporność i cyberbezpieczeństwo.

Po analizie luki, firma powinna skoncentrować się na nadzorze nad AI, opracowując jego model. Ważne jest, aby stworzyć główne zasady dla zespołów implementujących rozwiązania AI, które będą zgodne z politykami organizacji w zakresie odpowiedzialności społecznej, zaufania i etyki biznesowej. Plan wdrażania AI powinien równoważyć korzyści biznesowe i ryzyka, a także zawierać rekomendacje dotyczące docelowego modelu operacyjnego.

Istotnym etapem jest opracowanie mapy drogowej. Organizacja powinna dokonać przeglądu ustaleń z poprzednich faz i na tej podstawie opracować wewnętrzne rekomendacje. Mapa drogowa powinna być uszeregowana na podstawie ryzyka, wpływu i wysiłków przedsiębiorstwa. Pozwoli ona mierzyć postęp organizacji w zakresie wdrażania AI Governance oraz skoordynować działania różnych interesariuszy.

Wdrożenie AI Governance jest procesem wieloetapowym, wymagającym kompleksowej analizy i ekspertyzy branżowej. Dzięki przemyślanemu podejściu organizacje mogą skutecznie zarządzać sztuczną inteligencją, minimalizując ryzyka i maksymalizując korzyści płynące z jej wykorzystania.

Generatywna sztuczna inteligencja ma szansę zrewolucjonizować branżę ubezpieczeniową poprzez zwiększenie personalizacji produktów i usprawnienie oceny ryzyka. Nowa technologia pociąga za sobą jednak także znaczące wyzwania operacyjne i konieczność starannego zarządzania implementowanymi systemami. Organizacje wdrażające strategię dla wykorzystania sztucznej inteligencji muszą zmierzyć się z wyzwaniami w wielu obszarach, zarówno technologicznych, jak i organizacyjnych, czy biznesowych. Wymaga to całościowego podejścia do implementacji i zarządzania nowymi rozwiązaniami w ewoluującym krajobrazie regulacyjnym, podkreślonym przez AI Act.

Artykuł ukazał się w TOM 21, Numer 7/8, Lipiec / Sierpień 2024 Miesięcznika Ubezpieczeniowego

Podsumowanie

Należy podkreślić, że zarządzanie sztuczna inteligencją jest kluczowe z uwagi na odrębny cykl życia tego rodzaju systemów, który wymaga rozszerzenia tradycyjnych metodyk testowania, aby pokryć specyficzne atrybuty AI, takie jak ciągłe uczenie się i autonomia. Starannie opracowane ramy zarządzania AI pozwolą organizacjom skutecznie zarządzać ryzykiem, zapewniać zgodność z regulacjami i wykorzystywać transformacyjny potencjał AI dla uzyskania trwałej przewagi konkurencyjnej. Zarządzanie AI musi być integralną częścią strategii korporacyjnej, co zapewnić sukces podejmowanych wdrożeń i pozwoli uniknąć nieprzewidzianych komplikacji. Firmy muszą skupić się na identyfikacji obszarów, w których AI może przynieść największą wartość, jednocześnie minimalizując wskazane w niniejszym artykule obszary ryzyka. Wdrożenie ram zarządzania AI jest kluczowe dla umożliwienia rozwoju systemów, maksymalizacji zwrotu z inwestycji i zapewnienia odporności organizacyjnej w obliczu nieustannie ewoluującego środowiska technologicznego i regulacyjnego.

Polecane artykuły

MSSF 17 to początek całościowej transformacji roli finansów w ubezpieczeniach

Od stycznia 2023 roku obowiązuje nowy standard sprawozdawczości finansowej IFRS17. Co to w praktyce oznacza dla zakładów ubezpieczeń w Polsce?