EY désigne l’organisation mondiale des sociétés membres d’Ernst & Young Global Limited, lesquelles sont toutes des entités juridiques distinctes, et peut désigner une ou plusieurs de ces sociétés membres. Ernst & Young Global Limited, société à responsabilité limitée par garanties du Royaume-Uni, ne fournit aucun service aux clients.

L’IA ouvre la voie à une nouvelle médecine, plus prédictive mais va-t-elle pour autant remplacer le médecin ?

En résumé

- L’IA dispose de capacités supérieures à l’homme mais jusqu’à un certain point

- La dimension humaine ne pourra jamais être apportée par l’intelligence artificielle

- Un équilibre doit être trouvé entre l’IA et les médecins

L’intelligence artificielle recouvre des concepts très divers et un large périmètre d’applications. On peut la définir comme l’utilisation d’algorithmes capables d’exploiter un grand nombre de données afin d’en tirer des conclusions ou de formuler des hypothèses. L’augmentation du volume des données disponibles, ainsi que de la puissance de calcul, permet à l’IA d’automatiser un certain nombre de processus et lui donne des facultés d’apprentissage : le « machine learning ». Les possibilités de l’IA deviennent alors comparables, voire supérieures, aux capacités humaines dans certains domaines.

Dans le secteur de la santé, ses applications potentielles sont nombreuses, que ce soit dans le champ de la prévention, du diagnostic, du soin, du suivi, de la recherche clinique, de l’épidémiologie, du développement de nouveaux produits, ou de la régulation de l’offre du marché et des flux. Les typologies de données qu’elle peut exploiter dépendent directement de ces applications. Il peut s’agir de très grands volumes de données (Big Data), utilisés dans une optique de croisement et de corrélation, ou de données très spécifiques destinées à obtenir une conclusion sur une problématique précise.

L’utilisation de l’IA se répartit principalement en deux catégories de cas d’usage.

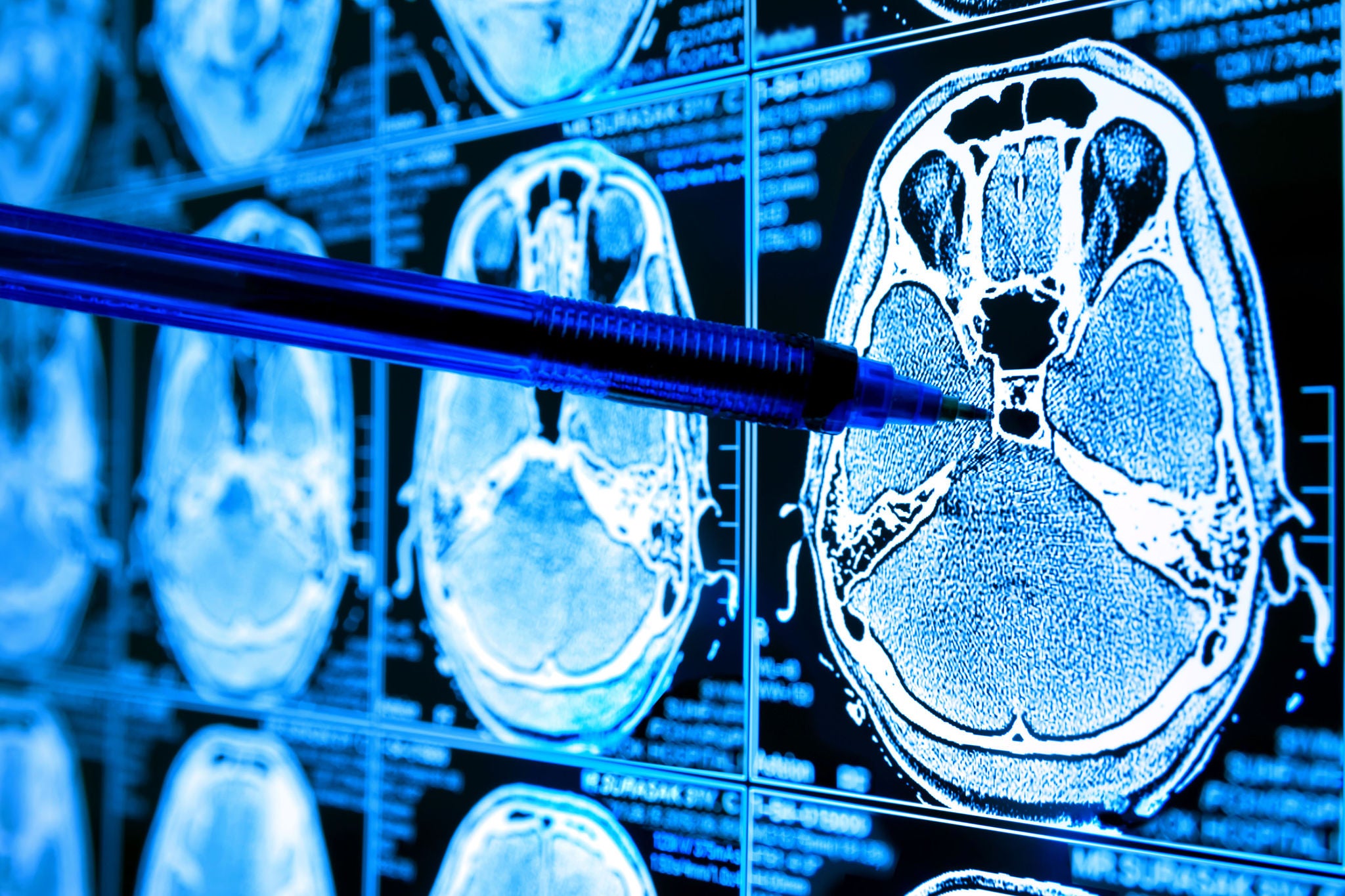

D’une part, les applications qui ont vocation à reproduire les activités humaines, plus rapidement et avec des résultats au moins aussi bons. C’est notamment le cas de l’analyse d’image, par exemple dans le cadre de la reconnaissance d’une tumeur sur une radiographie ou d’un mélanome sur une photographie de lésion cutanée. On inclut également dans cette famille l’analyse automatique de l’enregistrement des signaux, les assistants virtuels conversationnels - qui s’adaptent à la réponse de leur interlocuteur avec des recommandations personnalisées -, ou l’aide à la décision et au diagnostic par une meilleure détection des symptômes grâce à l’interprétation de données cliniques, de marqueurs biologiques, ou toute donnée utile (ECG, échantillons sanguins, etc.).

D’autre part, des utilisations destinées à croiser de très nombreuses données pour réaliser des analyses qui sont inaccessibles à l’homme. Ce type d’exploitation vise par exemple le dépistage de pathologies par l’analyse du génome, associée à des données cliniques et des données environnementales et appuyée par le contrôle en continu de données de vie réelle issues de dispositifs médicaux intelligents ou d’objets connectés. L’IA peut aussi prédire la réponse à des médicaments ou permettre une pharmacovigilance ou une surveillance épidémiologique grâce à sa capacité à identifier des signaux de masse non perceptibles par l’humain.

Ces applications montrent que l’IA se développe pour seconder le diagnostic, proposer un traitement ou encore « monitorer » un patient, ouvrant la voie à une médecine plus prédictive et personnalisée. Des études ont montré que l’IA atteint des résultats au niveau de ceux des meilleurs experts en un temps beaucoup plus court. Le recours à l’IA pourrait ainsi aboutir à un changement de paradigme pour certaines professions médicales, soit en se positionnant sur des activités d’analyse et de diagnostic, soit en réalisant des analyses inaccessibles à l’homme et qui révolutionneraient les modalités de prise en charge.

De fait, il est légitime de se poser la question : l’IA ne va-t-elle pas remplacer le médecin ?

Chapter 1

L’IA, une puissance capable de surpasser l’homme

Par ses algorithmes, l’intelligence artificielle démontre une capacité d’analyse surprenante

De nombreuses publications font état de résultats surprenants où l’IA fait mieux que les médecins. Les progrès de l’intelligence artificielle sont considérables dans l’analyse automatique d’images et de nombreuses publications démontrent sa capacité à dépister le mélanome cutané, le cancer du sein par mammographie ou le cancer du poumon par scanner.

Comparés à des non-spécialistes, ces algorithmes seraient même supérieurs. Ainsi Geoffrey Hinton, un des pères des réseaux neuronaux, a pu écrire « it’s quite obvious that we should stop training radiologists ».

En anatomopathologie, le développement de la numérisation des images pourrait amener à penser que l’on pourra se passer de toute une profession, les pathologistes. Au fur et à mesure des progrès de l’intelligence artificielle, et grâce à des algorithmes chaque jour plus performants, on peut comme Vinod Khosla, investisseur dans la Silicon Valley, prétendre que « les machines remplaceront 80 % des médecins dans le futur, dans un environnement dominé par des entrepreneurs et des professionnels non médicaux ». Une telle affirmation est possiblement un moyen de lever des fonds, mais est-ce bien comprendre les enjeux de la médecine ?

Chapter 2

Une dimension humaine que l’IA ne saura toutefois jamais apporter

Dénuée d’émotion et d’empathie, l’intelligence artificielle ne détient pas ce supplément d’âme propre à l’être humain

Certains pensent donc déjà que l’intelligence artificielle va gagner « contre » les médecins et pouvoir les remplacer à terme ; mais il se peut, au contraire, que l’inverse se produise, c’est-à-dire que les médecins développent leur capacité à soigner et à guérir en tirant profit des techniques d’intelligence artificielle.

La médecine, c’est une démarche qui repose sur un diagnostic, ou une suspicion, pour déboucher sur une décision de traitement qui comporte une part de risque ; c’est la prise en compte du fameux « ratio bénéfice – risque », car la médecine, c’est aussi prédire un avenir incertain. Pour cela, le médecin intègre de nombreux signaux en parallèle, issus de l’observation, de l’écoute, de l’examen clinique, des circonstances d’apparition, de l’environnement de la personne ; c’est de là que part la démarche diagnostique avant de prescrire un examen biologique, radiologique ou toute autre technique d’exploration. La démarche diagnostique débute par un échange avec le patient qui permet de formuler des hypothèses qui seront confirmées, ou non, par des examens complémentaires, et non l’inverse. L’ordinateur saura analyser une radiographie, comme un humain, voire mieux, mais si elle n’est pas prescrite, si le cheminement du médecin ne conduit pas à la radiologie, l’ordinateur n’aura pas les données pour dire : « Hey, Doc, prescris donc une radiographie ».

Pour résoudre ces problèmes complexes, il faut de l’intuition et un sens de l’observation qui intègre, outre l’examen clinique et l’exploration par des techniques d’imagerie médicale, la prise en compte du psychisme des individus, qui reste encore aujourd’hui une véritable « boite noire ».

Certaines applications d’IA permettent simplement de gagner du temps, comme par exemple la lecture automatique des enregistrements Holter développés par une start-up française. Elles ne remplacent pas le médecin, mais lui permettent de faire plus d’examens en parallèle.

Les techniques utilisant l’IA seront des supports pour le médecin, en tant qu’aide au diagnostic ou pour décider du meilleur traitement à prescrire ; ces techniques lui éviteront aussi des tâches répétitives ou fastidieuses en libérant un temps précieux qu’il pourra consacrer à autre chose (autres examens, plus grande disponibilité pour le patient, etc.) Elles ne constituent donc pas à ce titre un changement de paradigme.

Par analogie, la conduite autonome permise par le développement de l’intelligence artificielle libère l’attention du conducteur, mais l’automobile restera un moyen de locomotion à part entière et l’IA ne permet toujours pas la téléportation ! Libérer un temps précieux est un progrès certain, comme la poulie a permis de décupler la force de l’homme ou la roue, permis des déplacements plus aisés. En quelque sorte, l’irruption de l’IA serait pour le XXIe siècle l’équivalent de ce que furent l’invention de la poulie et de la roue dans l’Antiquité. Une révolution qui ouvre d’immenses perspectives, pour les patients… mais aussi et avant tout pour les médecins.

Chapter 3

Le pouvoir de décider, élément majeur pour l’emporter

Même si l’IA peut surpasser l’homme en matière d’analyse, ce dernier aura toujours la liberté de prendre les décisions finales

S’il arrive que ces techniques dépassent le pouvoir d’analyse d’un cerveau humain grâce à un traitement massif de données, le médecin reste le décideur en dernier ressort. S’il ne comprend pas comment l’algorithme est parvenu à telle ou telle conclusion, il peut décider de ne pas suivre ses recommandations.

Les meilleurs algorithmes permettront de résoudre correctement un problème dans 90 à 95 % des cas, mais leurs résultats ne seront que des suggestions qui nécessiteront une validation par un être humain. Une décision est prise ou n’est pas prise, elle ne peut pas être prise à 95 %.

L’IA pose le problème de la responsabilité dans la décision. Tout un chacun considère que l’erreur est humaine, même de la part des médecins. Mais qu’en sera-t-il si c’est l’ordinateur qui se trompe ?

Il est très improbable que l’on puisse un jour accorder une confiance aveugle à une proposition diagnostique ou thérapeutique non validée par l’homme ; pour prendre une autre analogie, même avec les progrès techniques qui permettent à un avion de voler sans pilote, on gardera encore longtemps un commandant de bord. L’ordinateur et l’IA seront de nouveaux acteurs du parcours de soin, qui apporteront un avis, formuleront une proposition de diagnostic ou de traitement, mais celle-ci sera suivie ou non par le médecin en fonction de sa perception globale de l’ensemble des facteurs.

La nouvelle Loi bioéthique, débattue au Parlement, a retenu que les dispositifs utilisant l’IA doivent rester sous le contrôle de l’homme et ne peuvent se substituer à une décision médicale. Par son article 11, elle ouvre la voie à l’IA sous une supervision humaine comme garantie centrale, fondée sur le droit du patient. Cette orientation est aussi partagée par le Comité Consultatif National d’Ethique (CCNE) et par la Commission européenne, qui traite de ces problématiques fondamentales à la fois dans son livre blanc sur l’intelligence artificielle de 2020 et au travers de récentes propositions réglementaires faites en 2021. Les implications de ces orientations, riches de (bon) sens, mériteraient de faire l’objet de réflexions plus abouties dans un article dédié.

La médecine veut être de plus en plus une science, et l’IA y contribue. A la biologie et à la psychologie, elle ajoute l’apport des mathématiques, de l’informatique, des statistiques ; mais la médecine doit conserver sa dimension humaniste, avec ce qu’il faut d’écoute, d’empathie, le « je ne sais quoi » qui inspire la confiance ; c’est cette confiance qui fait que le patient accepte, ou pas, ce qu’on lui fait subir comme examens et comme traitements. Le malade est un « être humain» dont la prise en charge doit être totale et prendre en compte autant le somatique que le psychologique dans toute sa complexité. Le malade ne se réduit pas simplement à une radiographie ou un organe, c’est avant tout une personne. Et qui mieux qu’une personne peut communiquer avec une autre personne, par un sourire, par une main, par une voix ? C’est toute la différence entre le « soin » et le « prendre soin », le « cure » et le « care » des anglo-saxons.

Les progrès de l’IA donneront encore plus de pouvoir aux médecins car la décision finale lui reviendra, comme il revient au pilote d’un avion de tenir compte, ou pas, des indications données par les capteurs et par les ordinateurs de bord.

En cancérologie, les diagnostics et les traitements sont discutés lors de réunions de concertation pluridisciplinaires où toutes les spécialités sont représentées. Demain, il y aura probablement aussi un ordinateur présent en « salle de staff », à travers un écran et une interface de communication. L’ordinateur, qui aura ingéré de multiples données, images et signaux, pourra être interrogé par les médecins durant leurs échanges, et leur donner « son avis sur la question ». Les médecins présents en tiendront compte ou non, s’étonneront de sa perspicacité ou, au contraire, s’esclafferont devant tant de « bêtise informatisée, tout l’inverse de l’intelligence artificielle », si la solution proposée par l’ordinateur leur parait stupide ou inadaptée. L’IA sera un compagnon, un support à la prise de décision, mais pas un obstacle à l’exercice de la médecine.

Chapter 4

Un équilibre à trouver entre l’IA et les médecins

Intégrer l’IA dans le processus de soins va permettre aux médecins de libérer du temps médical

L’intelligence artificielle n’a pas la vocation – ni la capacité – à remplacer le médecin. En revanche, il est certain que l’IA se positionnera comme l’un des outils clefs dans la prise en charge médicale, et ce faisant, fera évoluer le rôle du médecin. Cette évolution variera selon les spécialités médicales, dans lesquelles les besoins médicaux, tout comme le champ des possibles pour l’IA, sont différents. Par exemple, en radiologie l’IA permettra une analyse automatisée des images et proposera une première synthèse ainsi qu’un diagnostic au radiologue. Cela permettra de libérer du temps médical pour l’analyse détaillée des images d’intérêt, mais également pour échanger davantage avec l’équipe de soins, ou le patient lui-même, autour des hypothèses et des propositions. En cancérologie, l’IA pourra apporter un nouvel « avis médical » qui viendra enrichir les discussions au sein des réunions de concertation pluridisciplinaires, etc.

On peut également envisager que l’IA devienne un acte diagnostic à part entière venant supporter la décision médicale. Un tel usage de l’IA serait adapté, par exemple, à des pathologies rares et aiderait le médecin à identifier la pathologie et à orienter son patient. En tout état de cause, l’utilisation de l’IA en santé devra s’inscrire dans le cadre d’un dialogue avec le patient afin que ce dernier soit informé de son utilisation, des résultats obtenus ainsi que de la manière dont ils ont été pris en compte par le médecin dans sa décision finale.

De nombreux champs nouveaux sont ouverts par l’IA et nous n’avons pas encore suffisamment de recul pour appréhender l’ensemble des transformations qu’elle va provoquer. Néanmoins, nous avons une certitude : le développement de l’IA est conditionné par la disponibilité de très nombreuses données de qualité. La diversité de ces données est également un enjeu majeur pour assurer la reproductibilité des résultats dans d’autres structures ou contextes d’utilisation. Ainsi, pour permettre d’accélérer le développement de l’IA et la transformation de nos modèles de soins, il est primordial de produire, de collecter et de savoir réutiliser les données de santé : c’est un enjeu clef pour notre système de santé.

Ces constatations mettent en évidence tout le potentiel de l’IA dans le secteur de la santé. Mais combien d’applications IA sont déjà devenues aujourd’hui des cas d’usages opérationnels aidant au diagnostic voire remplaçant les non-experts ? Leur diffusion pose de multiples questionnements, qui ne sont pas seulement de la résistance au changement et qu’il convient d’analyser en profondeur. Les applications de l’IA qui révolutionneront la médecine existent, c’est une réalité. Mais il faut aussi qu’elles s’intègrent dans le processus de soins. Il reste donc beaucoup de chemin à parcourir pour assurer leur passage à l’échelle et transformer durablement le rôle du médecin (mais sans se substituer à lui, évidemment !).

Ce qu'il faut retenir

L’utilisation de l’Intelligence Artificielle ouvre la voie à une médecine plus prédictive et personnalisée. Même si l’IA dispose d’une puissance capable de surpasser l’homme, elle ne disposera jamais de la dimension humaine indispensable à la médecine. L’homme aura toujours le pouvoir de décider et devra trouver un équilibre dans l’utilisation de l’IA.